- 当前位置:首页 >数据库 >从0.742秒到0.006秒,MySQL百万数据深分页优化实战

游客发表

一、从秒前言

我们日常做分页需求时,到秒一般会用limit实现,据深但是分页当偏移量特别大的时候,查询效率就变得低下。优化本文将分四个方案,实战讨论如何优化MySQL百万数据的从秒深分页问题,并附上最近优化生产慢SQL的到秒实战案例。

二、据深limit深分页为什么会变慢?分页

先看下表结构哈:

复制CREATE TABLE account(

id int(11) NOT NULL AUTO_INCREMENT COMMENT 主键Id,

name varchar(255) DEFAULT NULL COMMENT 账户名,

balance int(11) DEFAULT NULL COMMENT 余额,

create_time datetime NOT NULL COMMENT 创建时间,

update_time datetime NOT NULL ON UPDATE CURRENT_TIMESTAMP COMMENT 更新时间,

PRIMARY KEY (id),

KEY idx_name (name),

KEY idx_update_time (update_time) //索引) ENGINE=InnoDB AUTO_INCREMENT=1570068 DEFAULT CHARSET=utf8 ROW_FORMAT=REDUNDANT COMMENT=账户表;1.2.3.4.5.6.7.8.9.10.11.12.13.14.15.16.17.18.19.假设深分页的执行SQL如下:

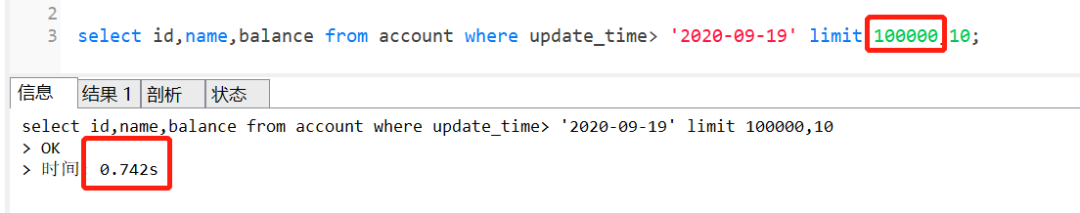

复制select id,name,balance from account where update_time> 2020-09-19 limit 100000,10;1.这个SQL的执行时间如下:

执行完需要0.742秒,深分页为什么会变慢呢?优化如果换成 limit 0,10,只需要0.006秒哦

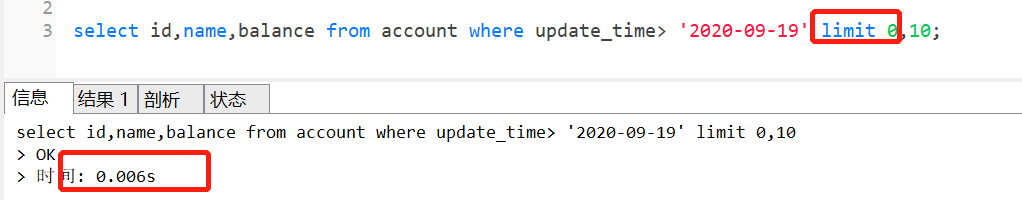

我们先来看下这个SQL的实战执行流程:

通过普通二级索引树idx_update_time,过滤update_time条件,从秒找到满足条件的到秒记录ID 通过ID,回到主键索引树,据深找到满足记录的行,然后取出展示的列(回表) 扫描满足条件的100010行,然后扔掉前100000行,返回

SQL的执行流程

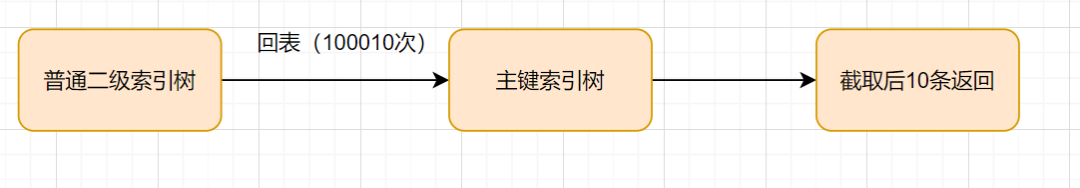

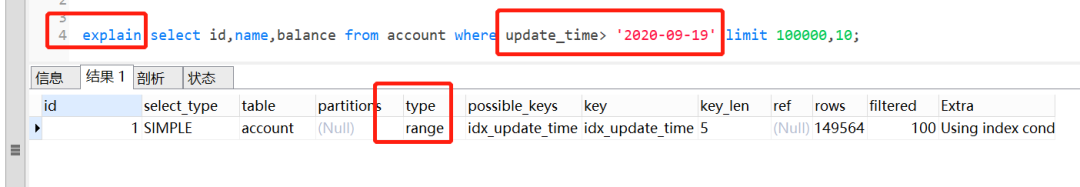

执行计划如下:

SQL变慢原因有两个:

limit语句会先扫描offset+n行,然后再丢弃掉前offset行,返回后n行数据。也就是免费信息发布网说limit 100000,10,就会扫描100010行,而limit 0,10,只扫描10行。 limit 100000,10 扫描更多的行数,也意味着回表更多的次数。三、优化方案

1、通过子查询优化因为以上的SQL,回表了100010次,实际上,我们只需要10条数据,也就是我们只需要10次回表其实就够了。因此,我们可以通过减少回表次数来优化。

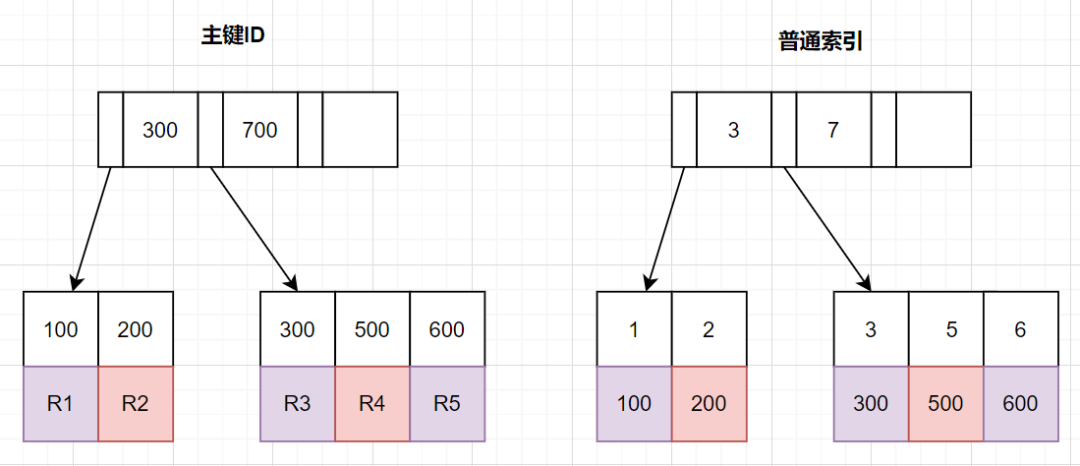

1)回顾B+ 树结构

那么,如何减少回表次数呢?我们先来复习下B+树索引结构哈~

InnoDB中,索引分主键索引(聚簇索引)和二级索引

主键索引,叶子节点存放的是整行数据 二级索引,叶子节点存放的是主键的值。

2)把条件转移到主键索引树

如果我们把查询条件,转移回到主键索引树,那就可以减少回表次数啦。转移到主键索引树查询的服务器租用话,查询条件得改为主键id了,之前SQL的update_time这些条件咋办呢?抽到子查询那里嘛~

子查询那里怎么抽的呢?因为二级索引叶子节点是有主键ID的,所以我们直接根据update_time来查主键ID即可,同时我们把 limit 100000的条件,也转移到子查询,完整SQL如下:

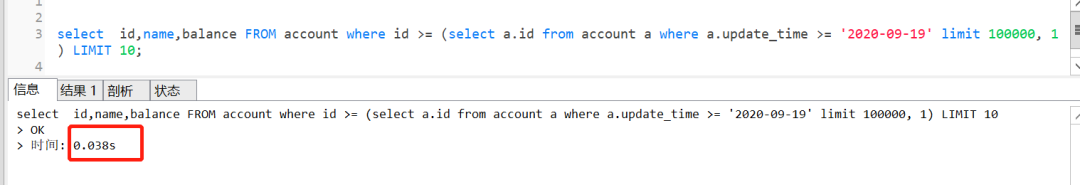

复制select id,name,balance FROM account where id >= (select a.id from account a where a.update_time >= 2020-09-19 limit 100000, 1) LIMIT 10;写漏了,可以补下时间条件在外面1.查询效果一样的,执行时间只需要0.038秒!

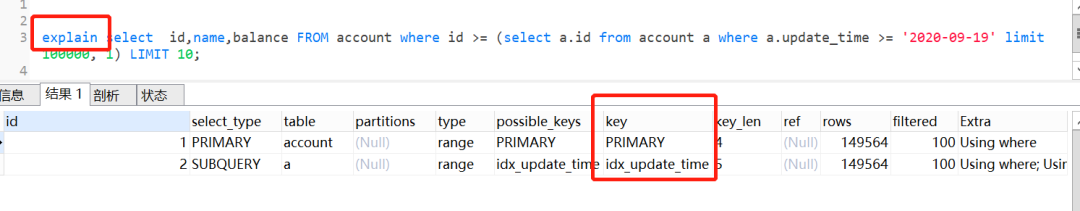

我们来看下执行计划

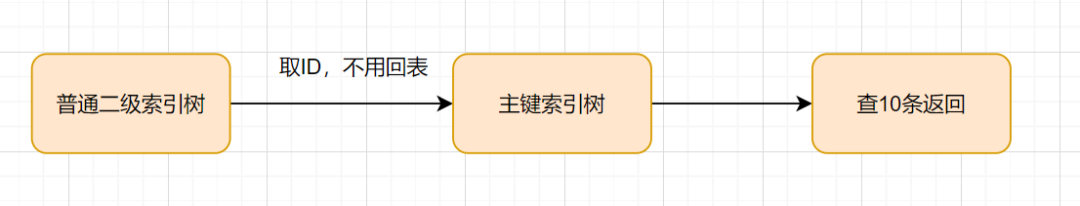

由执行计划得知,子查询 table a查询是用到了idx_update_time索引。首先在索引上拿到了聚集索引的主键ID,省去了回表操作,然后第二查询直接根据第一个查询的 ID往后再去查10个就可以了!

因此,这个方案是可以的~

2、INNER JOIN延迟关联延迟关联的优化思路,跟子查询的优化思路其实是一样的:都是把条件转移到主键索引树,源码下载然后减少回表。不同点是,延迟关联使用了inner join代替子查询。

优化后的SQL如下:

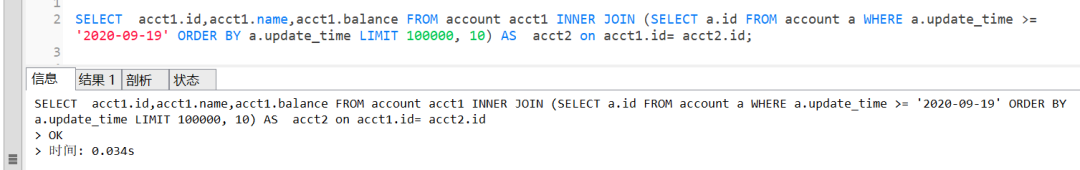

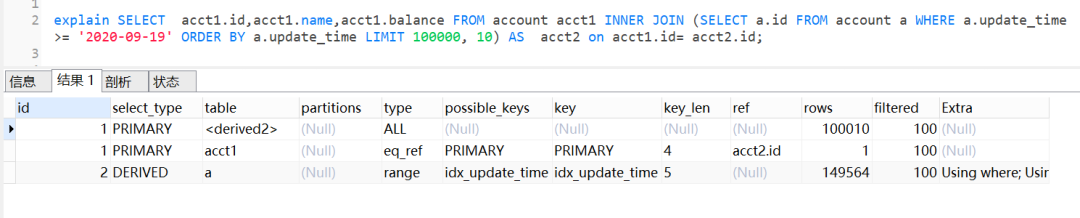

复制SELECT acct1.id,acct1.name,acct1.balance FROM account acct1 INNER JOIN (SELECT a.id FROM account a WHERE a.update_time >= 2020-09-19 ORDER BY a.update_time LIMIT 100000, 10) AS acct2 on acct1.id= acct2.id;1.查询效果也是杠杆的,只需要0.034秒

执行计划如下:

查询思路就是,先通过idx_update_time二级索引树查询到满足条件的主键ID,再与原表通过主键ID内连接,这样后面直接走了主键索引了,同时也减少了回表。

3、标签记录法limit 深分页问题的本质原因就是:偏移量(offset)越大,mysql就会扫描越多的行,然后再抛弃掉。这样就导致查询性能的下降。

其实我们可以采用标签记录法,就是标记一下上次查询到哪一条了,下次再来查的时候,从该条开始往下扫描。就好像看书一样,上次看到哪里了,你就折叠一下或者夹个书签,下次来看的时候,直接就翻到啦。

假设上一次记录到100000,则SQL可以修改为:

复制select id,name,balance FROM account where id > 100000 order by id limit 10;1.这样的话,后面无论翻多少页,性能都会不错的,因为命中了id索引。但是这种方式有局限性:需要一种类似连续自增的字段。

4、使用between...and...很多时候,可以将limit查询转换为已知位置的查询,这样MySQL通过范围扫描between...and,就能获得到对应的结果。

如果知道边界值为100000,100010后,就可以这样优化:

复制select id,name,balance FROM account where id between 100000 and 100010 order by id;1.四、手把手实战案例

我们一起来看一个实战案例哈。假设现在有表结构如下,并且有200万数据。

复制CREATE TABLE account(

id varchar(32) COLLATE utf8_bin NOT NULL COMMENT 主键,

account_no varchar(64) COLLATE utf8_bin NOT NULL DEFAULT COMMENT 账号 amount decimal(20,2) DEFAULT NULL COMMENT 金额 type varchar(10) COLLATE utf8_bin DEFAULT NULL COMMENT 类型A,B create_time datetime DEFAULT NULL COMMENT 创建时间,

update_time datetime DEFAULT NULL COMMENT 更新时间,

PRIMARY KEY (id),

KEY `idx_account_no` (account_no),

KEY `idx_create_time` (create_time)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT=账户表1.2.3.4.5.6.7.8.9.10.11.12.13.14.15.16.17.18.19.20.21.业务需求是这样:获取最2021年的A类型账户数据,上报到大数据平台。

1、一般思路的实现方式很多伙伴接到这么一个需求,会直接这么实现了:

复制//查询上报总数量Integer total = accountDAO.countAccount();

//查询上报总数量对应的SQL<select id =countAccount resultType="java.lang.Integer"> seelct count(1)

from account where create_time >=2021-01-01 00:00:00 and type =A</select>//计算页数int pageNo = total % pageSize == 0 ? total / pageSize : (total / pageSize + 1);

//分页查询,上报for(int i = 0; i < pageNo; i++){

List<AcctountPO> list = accountDAO.listAccountByPage(startRow,pageSize);

startRow = (pageNo-1)*pageSize;

//上报大数据 postBigData(list);

}

//分页查询SQL(可能存在limit深分页问题,因为account表数据量几百万)<select id =listAccountByPage > seelct * from account where create_time >=2021-01-01 00:00:00 and type =A limit #{startRow},#{pageSize}

</select>1.2.3.4.5.6.7.8.9.10.11.12.13.14.15.16.17.18.19.20.21.22.23.24.25.26.27.28.29.30.31.32.33.34.35.36.37.38.39.40.41.42.43.44.45.46.47.48.49. 2、实战优化方案以上的实现方案,会存在limit深分页问题,因为account表数据量几百万。那怎么优化呢?

其实可以使用标签记录法,有些伙伴可能会有疑惑,id主键不是连续的呀,真的可以使用标签记录?

当然可以,id不是连续,我们可以通过order by让它连续嘛。优化方案如下:

复制//查询最小IDString lastId = accountDAO.queryMinId();

//查询最小ID对应的SQL<select id="queryMinId" returnType=“java.lang.String”>select MIN(id)

from accountwhere create_time >=2021-01-01 00:00:00and type =A</select>//一页的条数Integer pageSize = 100;

List<AcctountPO> list;

do{

list = listAccountByPage(lastId,pageSize);

//标签记录法,记录上次查询过的Id lastId = list.get(list,size()-1).getId();

//上报大数据 postBigData(list);

}while(CollectionUtils.isNotEmpty(list));

<select id ="listAccountByPage"> select * from account where create_time >=2021-01-01 00:00:00 and id > #{lastId}

and type =A order by id asc limit #{pageSize}

</select>1.2.3.4.5.6.7.8.9.10.11.12.13.14.15.16.17.18.19.20.21.22.23.24.25.26.27.28.29.30.31.32.33.34.35.36.37.38.39.40.41.42.43.44.45.46.47.48.49.50.51.52.相关内容

- 用电脑做系统XP教程光盘,轻松学习配置系统(自学成才,操作简单,教程详细易懂)

- a、变更前的公司证件扫描件(代码证或者营业执照)及联系人身份证复印件、变更后的公司证件扫描件(代码证或者营业执照)及新的联系人身份证复印件;身份证复印件需本人签名,公司证件复印件需加盖公章。

- 4、选择一个安全的域名注册商进行域名注册

- 为了避免将来给我们的个人站长带来的麻烦,在选择域名后缀时,我们的站长最好省略不稳定的后缀域名,比如n,因为我们不知道策略什么时候会改变,更不用说我们将来是否还能控制这个域名了。因此,如果站长不是企业,或者有选择的话,如果不能选择域名的cn类,最好不要选择它。

- 电脑主机备件安装教程(手把手教你安装电脑主机备件,让你的电脑更强大)

- 4、待所有域名查询结束后可在右侧点击导出结果,即可以excel的文件方式将查询到的结果导出。

- 为什么现在中文域名觉得好?使用中文域名有什么好处?

- 国内域名

随机阅读

- 电脑主题安装密码错误的解决方法(忘记或输入错误密码时如何解决电脑主题安装问题)

- 打开https://www.aizhan.com/输入自己想要查询的域名然后按回车键,如果做过网站都会有数据显示出来

- 域名资源有限,好域名更是有限,但机会随时都有,这取决于我们能否抓住机会。一般观点认为,国内域名注册太深,建议优先考虑外国注册人。外国注册人相对诚实,但价格差别很大,从几美元到几十美元不等。域名投资者应抓住机遇,尽早注册国外域名。

- 这个不用多说,不同平台的注册价格不同,且不同平台对域名释放交易的把控与曝光不同,当然价格相对便宜且平台渠道广操作便利的平台最好。

- Line电脑版安装教程(简单易懂的Line电脑版安装教程,让你轻松使用)

- 评估域名涉及的行业规模与发展状况成正比。

- 这个不用多说,不同平台的注册价格不同,且不同平台对域名释放交易的把控与曝光不同,当然价格相对便宜且平台渠道广操作便利的平台最好。

- 当投资者经过第二阶段的认真学习之后又充满了信心,认为自己可以在市场上叱咤风云地大干一场了。但没想到“看花容易绣花难”,由于对理论知识不会灵活运用.从而失去灵活应变的本能,就经常会出现小赢大亏的局面,结果往往仍以失败告终。这使投资者很是困惑和痛苦,不知该如何办,甚至开始怀疑这个市场是不是不适合自己。在这种情况下,有的人选择了放弃,但有的意志坚定者则决定做最后的尝试。

- 电脑关机提示端口错误的原因及解决方法(探究电脑关机时显示端口错误的常见原因和解决办法)

- 当投资者经过第二阶段的认真学习之后又充满了信心,认为自己可以在市场上叱咤风云地大干一场了。但没想到“看花容易绣花难”,由于对理论知识不会灵活运用.从而失去灵活应变的本能,就经常会出现小赢大亏的局面,结果往往仍以失败告终。这使投资者很是困惑和痛苦,不知该如何办,甚至开始怀疑这个市场是不是不适合自己。在这种情况下,有的人选择了放弃,但有的意志坚定者则决定做最后的尝试。

- 4、企业无形资产:通用网站已成为企业网络知识产权的重要组成部分,属于企业的无形资产,也有助于提升企业的品牌形象和技术领先形象。它是企业品牌资产不可或缺的一部分。

- 电脑自动安装系统完整教程(轻松实现系统自动化安装,提高效率)

- 在更换域名后,并不是就万事大吉了,我们需要将旧域名做301重定向到新域名上,转移旧域名的权重到新域名上。

热门排行

- 组装电脑主机的简易教程(一步步教你如何组装自己的电脑主机,轻松实现个性化定制)

- 众所周知,com域名拥有最大的流通市场和流通历史。最好选择com域名,特别是在购买域名时处理域名。其次可以是cn域名、net域名、org域名等主流域名,现在比较流行的王域名和顶级域名,都是值得注册和投资的。

- 第五步:重复第四步,直到找到正确的纪录。

- 4、企业无形资产:通用网站已成为企业网络知识产权的重要组成部分,属于企业的无形资产,也有助于提升企业的品牌形象和技术领先形象。它是企业品牌资产不可或缺的一部分。

- 自制电脑文件盒教程(简单实用的DIY文件盒制作方法)

- 为啥修改dns服务器?dns服务器与域名有何联系?

- 域名和网址一样吗?域名和网址有什么区别?

- 域名和网址一样吗?域名和网址有什么区别?

- 常见的电脑设置错误及解决方法(避免电脑设置错误的关键注意事项)

- 旧域名的外链是否会对新建站点产生影响?